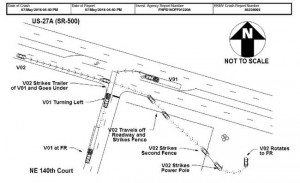

Situația este următoarea: în data de 7 mai 2016 (cu două luni în urmă), pe un drum național din Florida, un autoturism electric Tesla Model S, care era controlat de sistemul de condus semi-autonom Autopilot, a intrat în coliziune cu semiremorca unui tir, al cărui șofer a realizat o întoarcere fără să se asigure suficient.

În teorie, camera de filmat și senzorii sistemului Autopilot ar fi trebuit să sesizeze un obstacol atât de mare, deci ar fi trebuit să acționeze de urgență frânele și să oprească mașina în siguranță (sau măcar să ajute la producerea coliziunii la o viteză mult mai redusă). Din păcate, sistemul Autopilot se pare că nu a reacționat conform așteptărilor, mașina a intrat cu viteză sub semiremorcă, partea superioară a autoturismului fiind retezată, iar șoferul fiind ucis pe loc.

Și totuși, scandalul mediatic s-a declanșat doar pe final de iunie, când Tesla a anunțat pe blogul oficial că NHTSA (agenția guvernamentală responsabilă de siguranța rutieră în SUA) a demarat o investigație având ca obiect accidentul din 7 mai. De ce spun scandal? Deoarece majoritatea covârșitoare a titlurilor, fie că vorbim de publicații serioase, fie de publicații de cancan, subliniau faptul că e un accident fatal cu o mașină Tesla care funcționa în mod semi-autonom grație sistemului Autopilot, care nu a fost capabil să evite acest accident.

Așa cum se întâmplă mai nou în mass-media, situația nu a fost analizată deontologic, ci s-a mizat pe caracterul emotiv și pe speculațiile diverșilor specialiști ad-hoc, nu s-au cerut explicații din partea Tesla, nici din partea NHTSA (investigația este în curs, nu sunt făcute publice informații oficiale încă), iar detractorii mașinilor electrice și ale tehnologiei condusului autonom au inflamat spiritele în stil extremist.

Efectul de moment este că publicul are un feedback profund negativ față de sistemele de condus autonom, autoritățile au motive să tergiverseze sau chiar să blocheze legislația din acest domeniu, iar planurile de dezvoltare ale companiilor sunt amenințate. E adevărat, pe moment. Dar nimeni nu poate garanta că e doar un episod trecător.

Personal, apreciez foarte mult ceea ce face Elon Musk: eforturile de a forța limitele transportului nepoluant cu Tesla Motors, eforturile de a îmbunătăți peste limite rachetele produse de SpaceX, eforturile de a grăbi evoluția industriei solare sau eforturile de a promova noi mijloace de transport, cum este Hyperloop. Ei bine, nu sunt naiv să cred că aceste planuri monumentale pot decurge fără nicio problemă.

De aceea mă lasă rece specialiștii care apar acum cu o frază persiflatoare: „Era doar o chestiune de timp până când o mașină autonomă să producă un accident fatal, v-am zis noi că tehnologia nu este viabilă, nu poți înlocui factorul uman, mașinile autonome sunt periculoase, nu au viitor”. Și altele în același registru.

Mda, e foarte ușor să dai cu pietre când nu îți asumi niciun risc. Însă în lumea oamenilor de știință, a inventatorilor, a antreprenorilor și a cutezătorilor e valabil un principiu: „nu poți face omletă fără să spargi niște ouă”. Poate sună cinic dat fiind că vorbim de un accident fatal, dar să lăsăm sentimentalismele deoparte. Pentru că tehnologia mașinilor autonome urmează (nu poate, ci sigur) să schimbe fundamental societatea modernă.

Și cum „o floare nu aduce primăvara”, eu nu cred că un accident fatal este de natură să pună stop dezvoltării și implementării acestei tehnologii. De fapt, lucrurile sunt înțelese greșit din cauza capacității noastre limitate de a vedea tabloul general („nu vedem pădurea din cauza copacilor”, ca să apelez tot la înțelepciunea populară).

Conform celor de la Tesla, sistemul Autopilot nu a recunoscut semiremorca înaltă a tirului drept un obstacol periculos (era vopsită în alb, soarele bătea în ea, iar camera video a înțeles că e un indicator inofensiv…). Deci a fost vorba de o eroare, într-o situație foarte rară, pe care creatorii sistemului nu au intuit-o și preîntâmpinat-o.

Conform logicii unui programator sau inginer, este vorba de prima eroare majoră a unui sistem automat. Care, conform lui Elon Musk, intervine după 130 de milioane de mile în care sistemul Autopilot a fost utilizat de mii de mașini Tesla până acum (în condițiile în care la fiecare 94 de milioane de mile în SUA se înregistrează un accident fatal). Este o eroare care va fi corectată, iar sistemele Autopilot actualizate, astfel încât problema să fie eliminată.

Conform logicii celor care pun paie pe foc, vorbim de o problemă care nu poate fi corectată și care riscă să fie reprodusă de mii de ori pe zi, an de an. Nu știu dacă are sens să explic de ce afirmația asta sună stupid. Dar cine gândește așa nu ar trebui să fie luat în seamă. Doar proștii persistă în greșeală, cei deștepți învață din ele și le remediază. Iar cei de la Tesla Motors nu sunt nicidecum proști.

Aici aș mai face o paranteză, referitor la deja celebră problemă de etică a sistemelor de condus autonom: dacă apare o situație în care computerul are de ales între a face un accident în care să moară șoferul și un accident în care să omoare 10 pietoni, ce ar trebui să aleagă? Orice om întreg la minte ar fi de acord că e preferabil să avem o singură victimă, în loc de zece. Și totuși, discuțiile încearcă să găsească exact soluția imposibilă, de a salva pe toată lumea. Ceea ce, din păcate, induce opinia publică în eroare.

Așadar, ce înseamnă acest prim accident fatal? Dovada că mașinile autonome nu au viitor? Faptul că trebuie să ne temem de inteligența artificială?

Nicidecum. Accidentul a fost cauzat în primul rând de șoferul tirului (în vârstă de 62 de ani), care a apreciat greșit timpul pe care îl are la dispoziție pentru a face manevra, deci nu a acordat prioritate cum ar fi trebuit. În plus, dacă semiremorca ar fi avut protecții laterale, accidentul nu ar fi fost atât de grav – acoperișul a fost retezat, la fel ca în cazul altor 250 de accidente similare care se petrec anual în SUA.

Apoi cel care conducea mașina Tesla Model S se pare că urmărea un film pe un DVD, în loc să fie atent la drum – Tesla specifică foarte clar că sistemul Autopilot NU PREIA RESPONSABILITATEA șoferului, ci e într-o fază beta, oferind asistență. Aici deja intervine problema percepției oamenilor – e suficient să ne uităm pe youtube.com la câteva filmări cu proprietari de Tesla care pur și simplu abuzează de Autopilot și care nu par să înțeleagă că responsabilitatea e a lor, nu a sistemului electronic.

Deci, până să ajungem la a blama sistemul Autopilot, dinamica acestui accident fatal pornește tot de la erorile umane, pe fondul unor circumstanțe extrem de rare. Și cam asta este situația, obiectiv vorbind. Sunt sigur că vor mai fi accidente cu mașini echipate cu Autopilot, sau cu alte sisteme de condus autonom. Dar toate vor contribui la îmbunătățirea radicală a acestor sisteme.

Ceea ce va duce la scăderea drastică a accidentelor rutiere, care acum sunt estimate pe plan global la un număr de circa 1,5 milioane de accidente fatale, respectiv 50 de milioane de accidente cu răniți. Dacă în cazul mașinilor autonome se va ajunge la 1.000 de accidente fatale pe an, deja am vorbi de o reducere de 1.500 de ori față de situația actuală! Iar asta este varianta super-pesimistă, pentru că specialiștii sunt siguri că numărul deceselor ar putea scădea până la numai câteva sute.

Deci sfatul meu este să nu înghițiți pe nemestecate informațiile despre acest subiect. Regretabil, din punct de vedere emotiv, dar care va contribui serios la evoluția tehnologiei sistemelor de condus autonom. Ale cărei avantaje le veți înțelege doar dacă veți fi ceva mai mult informați.