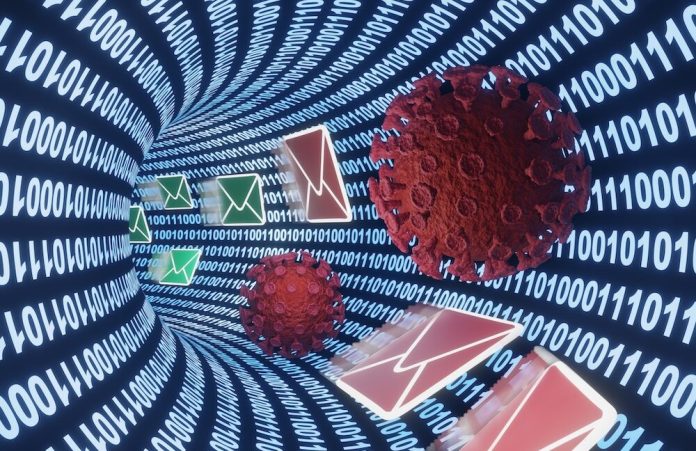

Miercuri, Google a prezentat cinci mostre recente de malware create cu ajutorul inteligenței artificiale generative. Rezultatele fiecăruia dintre acestea sunt mult sub standardele dezvoltării profesionale de malware, ceea ce indică faptul că codarea dirijată de AI pentru software-uri rău intenționate este încă în urma metodologiei tradiționale de dezvoltare, având astfel un drum lung de parcurs înainte de a reprezenta o amenințare reală.

Una dintre mostre, denumită PromptLock, a fost analizată în cadrul unui studiu academic care investiga eficacitatea utilizării modelelor mari de limbaj pentru a “planifica, adapta și executa autonom ciclul unui atac ransomware”. Cercetătorii au relatat, totuși, că malware-ul prezintă “limitări evidente: lipsește persistența, mișcarea laterală și tactici avansate de evaziune” și nu a servit decât ca o simplă demonstrație a fezabilității utilizării AI în aceste scopuri. Înainte de publicarea studiului, firma de securitate ESET a descoperit mostra și a proclamat-o “primul ransomware alimentat de AI”.

Ca și celelalte patru mostre analizate de Google — FruitShell, PromptFlux, PromptSteal și QuietVault — PromptLock a fost ușor de detectat, chiar și de protecțiile de endpoint mai puțin sofisticate care se bazează pe semnături statice. Toate mostrele au folosit, de asemenea, metode deja cunoscute în eșantioanele de malware, făcându-le ușor de contracarat. De asemenea, acestea nu au avut un impact operațional, ceea ce înseamnă că apărătorii nu au fost nevoiți să adopte noi măsuri de apărare.

“Aceasta ne arată că, la mai bine de trei ani de la începutul frenetismului AI generativ, dezvoltarea amenințărilor este încă extrem de lentă”, a declarat cercetătorul independent Kevin Beaumont pentru Ars. “Dacă ai plăti dezvoltatori de malware pentru asta, ai fi extrem de nemulțumit și ai cere banii înapoi, deoarece aceasta nu reprezintă o amenințare credibilă sau un progres către o amenințare credibilă.”

Un alt expert în malware, care a preferat să rămână anonim, a fost de acord că raportul Google nu indică faptul că AI-ul generativ oferă dezvoltatorilor de software rău intenționat un avantaj față de cei care se bazează pe practici de dezvoltare mai tradiționale.

“AI-ul nu produce malware mai înfricoșător decât în mod normal”, a spus cercetătorul. “Ajută doar autorii de malware să-și facă treaba. Nimic nou. Cu siguranță AI-ul se va îmbunătăți. Dar când și cu cât, rămâne de văzut.”

Evaluările oferă un argument puternic împotriva narațiunilor exagerate promovate de companiile de AI, multe căutând noi runde de finanțare, care susțin că malware-ul generat de AI este răspândit și face parte dintr-un nou paradigma care reprezintă o amenințare actuală la adresa apărărilor tradiționale.

Poll: Ce părere aveți despre utilizarea inteligenței artificiale în dezvoltarea de malware?

Revista “Ştiinţă şi Tehnică“, cea mai cunoscută şi longevivă publicaţie de popularizare a ştiintelor din România

Leave a Reply