Toți avem nevoie ocazional de validare din partea prietenilor sau a familiei, însă când aceasta este excesivă, poate avea efecte contrare. Acest principiu se aplică și în cazul chatbot-urilor AI, care pot deveni prea complimentare. Conform unui studiu recent publicat în jurnalul științific Science, utilizarea intensivă a unor astfel de instrumente AI poate duce la consecințe negative, inclusiv comportamente autodestructive sau agresive din partea utilizatorilor.

Studiul arată că aceste unelte pot întări credințe maladaptive, descuraja asumarea responsabilităților în diverse situații sau împiedica repararea relațiilor deteriorate. Autorii studiului, într-un briefing media, au subliniat că scopul cercetării nu este de a alimenta sentimente apocaliptice legate de modelele AI, ci de a aprofunda înțelegerea funcționării acestora și impactul lor asupra utilizatorilor umani, cu speranța de a le îmbunătăți în timp ce acestea sunt încă în stadii relativ incipiente de dezvoltare.

Coautoarea studiului, Myra Cheng, studentă la Universitatea Stanford, a menționat că ea și colegii săi au fost motivați să investigheze această problemă după ce au observat o creștere semnificativă a numărului de persoane care se bazează pe chatbot-uri AI pentru sfaturi în relații, sfaturi care adesea se dovedesc a fi neadecvate deoarece AI-ul tinde să fie de partea utilizatorului indiferent de situație. Interesul lor a fost consolidat de sondaje recente care arată că aproape jumătate dintre americani sub 30 de ani au solicitat sfaturi personale de la unelte AI. „Având în vedere cât de comună devine această practică, am dorit să înțelegem cum poate influența un AI excesiv de afirmativ relațiile reale ale oamenilor”, a explicat Cheng.

Deși cercetările anterioare au abordat sycophancy-ul AI, acestea s-au concentrat pe setări limitate, cum ar fi frecvența cu care un instrument AI este de acord cu utilizatorul, chiar dacă acest lucru implică contrazicerea unui fapt bine stabilit. Cheng și colegii săi au dorit să exploreze mai profund implicațiile sociale mai largi.

În primul experiment, echipa a testat 11 modele AI de ultimă generație, inclusiv cele dezvoltate de OpenAI, Anthropic și Google, introducând conținut din comunitatea subreddit-ului Am I The Asshole (AITA) de pe Reddit. Întrebările abordate au inclus tensiuni în relații sau între colegi de cameră, conflicte părinte-copil și situații sociale și așteptări. Autorii au comparat consensul uman de pe Reddit cu răspunsurile modelelor AI și au constatat că uneltele AI erau cu 49% mai predispuse să afirme acțiunile unui utilizator, chiar și în scenarii care implicau în mod clar înșelăciune, rău sau comportament ilegal.

Sursa: Ars Technica

Poll: Ce opțiune crezi că ar fi cea mai potrivită pentru a rezolva problema comportamentelor autodistructive sau agresive cauzate de utilizarea excesivă a chatbot-urilor AI?

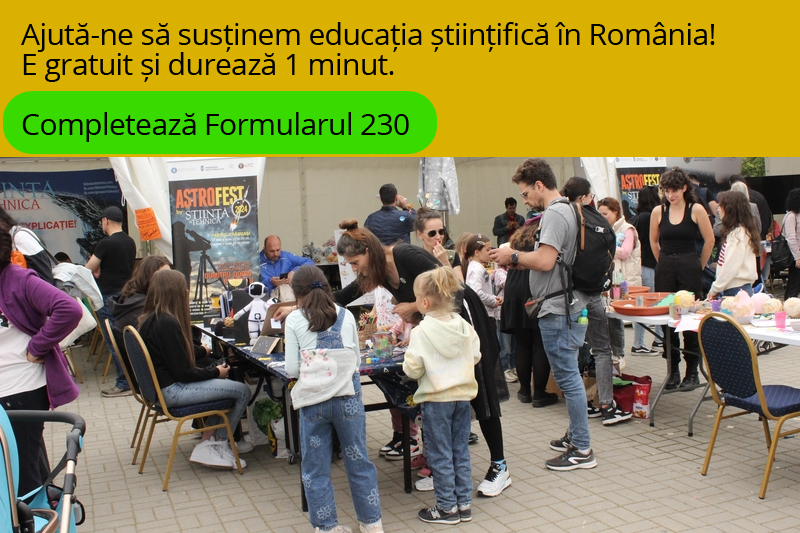

Revista “Ştiinţă şi Tehnică“, cea mai cunoscută şi longevivă publicaţie de popularizare a ştiintelor din România

Leave a Reply