mai puțin decât se vede –

Google ia căldură pentru un videoclip demonstrativ AI înșelător care l-a încurajat pe concurentul GPT-4.

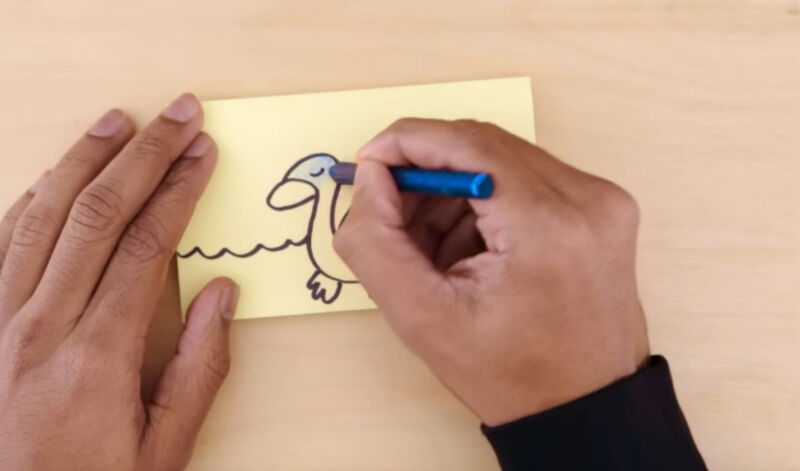

Mărește / O foto din videoclipul promoțional Gemini AI de la Google, lansat miercuri.

Google se confruntă cu controverse în rândul experților în inteligență artificială pentru un videoclip promoțional Gemeni înșelător lansat miercuri care pare să arate noul său model AI care recunoaște indicii vizuale și interacționează vocal cu o persoană în timp real. După cum a raportat Parmy Olson pentru Bloomberg, Google a recunoscut că nu a fost cazul. În schimb, cercetătorii hrănite imagini statice la model și a editat împreună răspunsuri de succes, denaturand parțial capacitățile modelului.

„Am creat demonstrația prin capturarea imaginilor pentru a testa capacitățile Gemenii într-o gamă largă de provocări”, a spus un purtător de cuvânt. „Apoi i-am solicitat pe Gemeni folosind cadre de imagini statice din filmare și solicitări prin text”, un purtător de cuvânt al Google spuse Olson. După cum subliniază Olson, Google a filmat o pereche de mâini umane făcând activități, apoi a arătat imagini statice lui Gemini Ultra, una câte una. Cercetătorii Google au interacționat cu modelul prin text, nu prin voce, apoi au ales cele mai bune interacțiuni și le-au editat împreună cu sinteza vocii pentru a realiza videoclipul.

În prezent, rularea imaginilor statice și a textului prin modele masive de limbi mari este intensivă din punct de vedere computațional, ceea ce face ca interpretarea video în timp real să fie în mare măsură nepractică. Acesta a fost unul dintre indiciile care i-au determinat pentru prima dată pe experții AI să creadă că videoclipul induce în eroare.

Videoclipul Google Gemini în cauză.

„Videoclipul Google a făcut să pară că ai putea să arăți diferite lucruri lui Gemini Ultra în timp real și să vorbești cu el. Nu poți”, Olson. a scris într-un tweet. Un purtător de cuvânt al Google a spus că „vocea utilizatorului este toate extrase reale din instrucțiunile reale folosite pentru a produce rezultatul Gemini care urmează”.

Jucându-mă la curent cu hype

În ultimul an, parvenitul OpenAI a stânjenit Google trăgând înainte în tehnologia AI generativă, dintre care unele își au originea în descoperirile din laboratorul de cercetare Google. Gigantul căutărilor a fost chinuindu-se pentru a ajunge din urmă de la începutul acestui an, depunând mare efort în concurența ChatGPT Bard și modele de limbaj mari precum PALM 2. Google l-a încadrat pe Gemini drept primul rival adevărat al GPT-4 de la OpenAI, care este încă văzut pe scară largă drept lider de piață în modelele mari de limbă.

La început, părea că totul va fi planificat. După ce a anunțat Google Gemini miercuri, acțiunile companiei au fost cu 5 procente. Dar în curând, experții AI au început culegând în afară Afirmațiile Google, probabil, exagerate de „capabilități de raționament sofisticate,” inclusiv repere care nu se va putea înseamnă mult, concentrându-se în cele din urmă pe videoclipul promoțional Gemeni cu rezultate neclare.

În video contestat, intitulat „Hands-on with Gemini: Interacting with multimodal AI”, vedem o vedere a ceea ce aparent vede modelul AI, însoțită de răspunsurile modelului AI în partea dreaptă a ecranului. Cercetătorul desenează linii ondulate și rațe și îi întreabă pe Gemeni ce poate vedea. Telespectatorul aude o voce, aparent a Gemini Ultra, care răspunde la întrebări.

După cum subliniază Olson în articolul său Bloomberg, videoclipul nu specifică nici că demonstrația de recunoaștere folosește probabil Gemini Ultra, care nu este încă disponibil. „Ascunderea unor astfel de detalii indică efortul de marketing mai larg aici: Google ne vrea [to] amintiți-vă că are una dintre cele mai mari echipe de cercetători AI din lume și acces la mai multe date decât oricine altcineva”, a scris Olson.

Luate singur și dacă sunt reprezentate mai precis (cum sunt pe această pagină de blog Google), abilitățile de recunoaștere a imaginii ale Gemenilor nu sunt de ce să strănuți. Ele par aproximativ la egalitate cu capacitățile OpenAI multimodal GPT-4V (GPT-4 cu viziune) Model AI, care poate recunoaște și conținutul imaginilor statice. Dar, atunci când a fost editat împreună în scopuri promoționale, a făcut ca modelul Google Gemini să pară mai capabil decât este și asta i-a încurajat pe mulți.

„Nu mă pot opri să mă gândesc la implicațiile acestui demo”, a postat pe Twitter Organizatorul TED, Chris Anderson, joi. „Cu siguranță nu este o nebunie să crezi că cândva anul viitor, un Gemeni 2.0 în vârstă ar putea să participe la o ședință a consiliului de administrație, să citească documentele de informare, să se uite la diapozitive, să asculte cuvintele fiecăruia și să facă contribuții inteligente la problemele dezbătute? Acum spune-mi. . Asta nu ar conta ca AGI?”

“Această demonstrație a fost incredibil de editată pentru a sugera că Gemenii sunt mult mai capabili decât sunt.” răspuns inginerul de software de pionier Grady Booch. — Ai fost înșelat, Chris. Și să le fie rușine că au făcut asta.

Sursa informației: arstechnica.com

Revista “Ştiinţă şi Tehnică“, cea mai cunoscută şi longevivă publicaţie de popularizare a ştiintelor din România

Leave a Reply