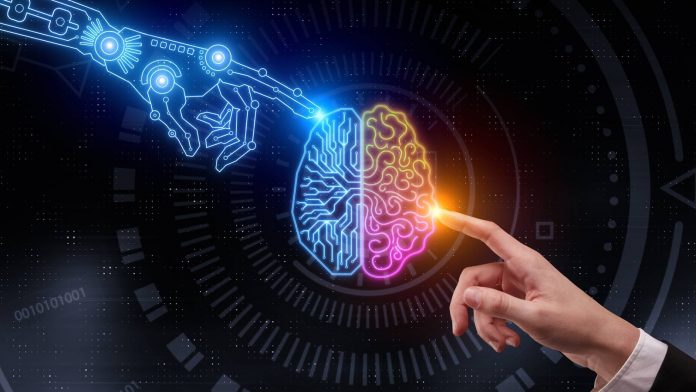

Atunci când vine vorba despre viitorul civilizației umane, mă declar a fi un optimist incorigibil. Totuși, nu pot să nu mă gândesc la amenințările care ar putea să ne aștepte după colț, dacă, în entuziasmul modernizării societății, nu vom fi atenți la drumul pe care îl vom urma. Una dintre cele mai insidioase dintre ele este chiar marea promisiune a zilelor noastre: inteligența artificială.

Inteligența artificială, puțină istorie

M-am uitat în”Marele dicționar de neologisme”, ediția din anul 2000, și am aflat că ”INTELIGÉNȚĂ s. f. capacitate a individului de a se adapta la împrejurări noi, de a sesiza relațiile esențiale și de a găsi o ieșire dintr-o anumită situație, de a rezolva probleme noi; deșteptăciune. ◊ om inteligent. ♦ ~ artificială = capacitate a sistemelor tehnice evoluate de a obține performanțe cvasiumane. (< fr. intelligence, lat. intelligentia, germ. Intelligenz)”. Credeam că o definiție atât de simplă și de clară ar fi suficientă. Apoi, după ce am recitit-o mi-am dat seama că este nevoie și de o mică poveste.

În vara anului 1956, în cadrul unei școli de vară organizate la Dartmouth College (SUA) se s-a discutat, oficial, pentru prima oară, conceptul de inteligență artificială. Tema fost anunțată cu un an mai devreme de către un grup de mari informaticieni alcătuit din John McCarthy, Marvin Minsky, Nathaniel Rochester și Claude Shannon. ”Propunem ca pentru o perioadă de două luni, în vara anului 1956, un grup de 10 oameni să discute despre inteligența artificială […]. Discuțiile vor pleca de la conjectura conform căreia orice aspect al învățării sau orice altă caracteristică a inteligenței poate fi descrisă în principiu atât de bine, încât să poată fi simulat de către o mașină. Vom încerca să înțelegem cu mașinile vor putea folosi limbajul, pentru a opera cu idei abstracte și pentru a rezolva probleme, care în prezent sunt accesibile doar oamenilor. Credem că se vor realiza progrese importante în această direcție, dacă un grup de oameni de știință bine selectați vor lucra împreună de-a lungul unei veri.”

Trebuie să precizez faptul că anul 1956 a fost momentul care a marcat recunoaşterea inteligenței artificiale ca domeniu al științei. De fapt conceptul este ceva mai vechi. Se vorbește mai puțin despre asta, dar unul dintre pionierii inteligenței artificiale a fost românul Ștefan Odobleja care publica în 1938, la Paris, în două volume, lucrarea Psychologie consonantiste (Psihologia consonantistă), în care se puneau bazele ciberneticii. Despre această operă monumentală academicianul Alexandru Surdu, spunea, în 2018, că ”[În Psihologia Consonantistă] Odobleja milita pentru modelarea comportamentelor organismului uman pentru a ajunge la modele în rezonanță cu gândirea omului, cu gândirea naturală.”

Abia 10 ani mai târziu, în 1948, Alan Turing, în articolul Intelligent Machinery, descria matematic rețele neuronale conectate aleatoriu și capabile de autoorganizare. Doi ani mai târziu, în Computing Machinery and Intelligence, el schița ceea ce avea să poarte numele de test Turing. Conform acestui test un om este pus să discearnă între o altă persoană și un calculator, fără a-i vedea, doar pe baza răspunsurilor pe care le primește la întrebările pe care le pune. Răspunsurile se vor da numai în scris, pe ecranul unui monitor sau tipărite de către o imprimantă. Dacă răspunsurile calculatorului sunt atât de bune, astfel încât cel care pune întrebările nu își poate da seama că le primește de la o mașină, atunci ea a trecut testul și se poate spune că gândește.

Trebuie să vă mai spun că, cel puțin deocamdată, sistemele de inteligență artificială nu încearcă deloc să imite funcționarea sistemelor biologice, ci doar să obțină rezultate similare cu cele ale inteligenței umane. Asta seamănă cumva cu zborul avionului raportat la cel al păsărilor.

Inteligența artificială se bazează pe învățarea automată (machine learning) și/sau pe învățarea profundă (deep learning). Practic, algoritmul se rescrie, pe măsură ce învață să rezolve o anumită sarcină, cum ar fi recunoașterea fețelor, a scrisului de mână etc. Aici apare o primă și importantă problemă: nici măcar cei care l-au programat sau l-au ”educat” nu-l mai pot înțelege dincolo de un punct al evoluției sale.

Desigur, încă de pe acum, când suntem în zorii inteligenței artificiale, vedem rezultate spectaculoase ale aplicării ei. Cu ajutorul inteligenței artificiale se pot diagnostica anumite forme de cancer mult mai bine decât ar face-o medicii umani. Tot ea poate fi folosită cu succes pentru realizarea de analize financiare extrem de sofisticate sau poate fi folosită în domeniul juridic. Deja au început să apară automobile și aparate de zbor, care sunt complet autonome. Inteligența artificială a pătruns și în casele noastre sub forma asistenților personali Alexa, Siri sau Google. Exemplele ar putea continua. Așa cum vă spuneam la începutul acestui text, sunt foarte optimist atunci când privesc către viitorul inteligenței artificiale. Dar nu mă pot împiedica să nu încerc să arunc o privire către pericolele pe care le implică răspândirea și dezvoltarea rapidă a ei.

Pericole

În primul rând, nu ai cum să nu te gândești că utilizarea inteligenței artificiale, împreună cu robotizarea, va duce la o pierdere masivă de locuri de muncă. Doar ca un exemplu simplu: peste câteva decenii șoferii profesioniști vor deveni doar un capitol al istoriei, fiind înlocuiți de vehicule autonome. Probabil că aceeași soartă o vor avea și mulți angajați din grupa gulerelor albe, inclusiv din zona mass-media. Este greu de făcut acum o evaluare detaliată, dar cred că mulți dintre noi vom trăi un șoc similar cu cel al țesătoarelor din Lyon, care au văzut cum, aproape peste noapte, munca lor meticuloasă a fost înlocuită cu cea a unor mașini automate. Această ameninţare ține, deocamdată, de un viitor previzibil și nu mă neliniștește prea mult. Suntem într-o situație similară celei de la începutul revoluției industriale. Sunt convins că societatea se va adapta schimbării într-un fel sau altul. Optimist fiind, îndrăznesc să cred că există toate șansele ca lumea de mâine să fie una mult mai bună decât cea în care trăim acum.

Iar în lumea asta de acum vedem foarte limpede amenințări cu mult mai mari și extrem de directe. Una dintre ele are legătură cu testul lui Turing. Sistemele de inteligență artificială pot genera texte care să fie practic imposibil de recunoscut ca fiind scrise de o mașină. Ele pot fi folosite pentru a genera masiv știri false (fake news) care se pot răspândi rapid prin intermediul rețelei Internet.

Să vă dau un exemplu benign. Există un algoritm performant de generare automată de texte cu ajutorul inteligenței artificiale care poartă GPT-3, care este open source. Versiunile anterioare nu erau accesibile publicului, deoarece creatorii lui se temeau că el va putea fi abuzat. Versiunea actuală poate fi utilizată numai de către cercetători autentificați ca atare. Liam Porr, student la Universitatea California Berkeley, a făcut solicitat să folosească aplicația. Cum autorizarea întârzia să îi parvină, el a apelat la un prieten, doctorand la aceeaşi universitate, care avea deja autorizarea necesară. Nu i-a trebuit mult timp pentru a îl ”învăța” pe algoritm să genereze texte de blog, plecând de la un titlu ales de el. Timp de două săptămâni a postat zilnic texte generate automat de către GPT-3. În cele din urmă Liam Porr și-a prezentat experiența pe blogul său real. ”Scriam doar titlul și o scurtă introducere, adăugam o fotografie, după care GPT-3 făcea restul. Blogul a avut mai mult de 26.000 de vizitatori și aproape 60 de abonați… Numai o singură persoană și-a dat seama că textul a fost generat de GPT-3.”

Lucrurile pot să devină și mai îngrijorătoare. Pot fi generate videoclipuri false, în care personalități de încredere să anunțe tot fel de lucruri imaginate cu ajutorul inteligenței artificiale, în acest caz putem vorbi despre ”deepfake”. Și în acest caz există aplicații open source. Un exemplu în acest sens este Faceswap, pe care o puteți descărca gratuit. Aplicația poate rula sub Windows, MacOS și Linux. În prezent cel puțin o mie de oameni folosesc această aplicație, care este suficient de prietenoasă astfel încât să poată fi utilizată de către oameni ce nu au decât cunoștințe medii în domeniul informaticii. Faceswap utilizează o interfață foarte simplă care îndeplinește trei funcții principale.

Nu ai nevoie de un computer superperformant pentru a realiza acest tip de deepfake. Trebuie doar să ai răbdare cu ”antrenarea” aplicației, care ți va lua câteva săptămâni, în funcție de durata clipului pe care vrei să îl generezi.

Extragerea, prin care sunt detectate fețele umane dintr-un clip video, care mai apoi sunt stocate într-o bază de date, sub forma unui șir de imagini

Antrenarea, prin care aplicația ajunge să ”înțeleagă” și să recreeze fețe umane care vor fi folosite pentru a înlocui imaginea din clipul original.

Conversia, prin care aplicația recreează videoclipul original, înlocuind a fața umana inițială cu cea aleasă de către utilizator.

Vedeți? Orice om conectat la Internet ar putea genera extrem de eficient știri false, ajutat de inteligența artificială. Vestea bună stă în faptul că au început să fie concepute sisteme bazate pe inteligența artificială, care sunt capabile să le detecteze. Îmi și imaginez bătălia între inteligențele artificiale situate de cele două părți ale baricadei. Cred că vom asista la evoluții similare cu cele din timpul cursei înarmării… Nu vreau să îmi imaginez acum ce s-ar putea întâmpla atunci când organizații care dispun de mari resurse finanțare vor decide că a sosit momentul unui atac masiv de fake news și de deepfake.

În prezent mai există și alte pericole legate de inteligența artificială. Ea tinde să devină, în mâna unor mari corporații sau guverne, o replică ale orwelianului Big Brother. Nu voi insista acum asupra acestui aspect. În fond multe dintre tehnologiile civilizației umane pot fi benefice sau nocive, în funcție de felul în care sunt utilizate.

Dar ce se va întâmpla dacă inteligența artificială se va transforma într-o superinteligență autonomă? Subiectul a fost tratat adesea în romanele SF. În acest text vreau să vă propun o abordare ceva mai rațională și să vă recomand o carte formidabilă: Superintelligence – Paths, Dangers, Strategies scrisă de Nick Bostrom, profesor de filosofie la Universitatea Oxford. Eu am citit-o pe nerăsuflate și, vă mărturisesc, această carte mi-a dat imboldul pentru a scrie acest articol.

În prefața cărții Bostrom arată că: ”Dacă într-o zi vom construi o mașină care va depăși inteligența creierului uman, atunci această nouă superinteligență va deveni foarte puternică. Și, la fel cum soarta gorilelor depinde mai mult de noi, oamenii, decât de acțiunile gorilelor înseși, la fel soarta oamenilor va depinde de acțiunile superinteligenței.

Noi avem un avantaj: noi suntem cei care vor construi această superinteligență și o putem învăța să protejeze valorile umane. Avem motive puternice să o facem. În practică, problema controlului – problema controlului acțiunilor superinteligenței – este extrem de dificilă. Vom avea la dispoziție o singură încercare. O dată cu apariția unei inteligențe neprietenoase, ea ne va împiedica să-i modificăm preferințele. Din acel moment, soarta noastră va fi pecetluită.”

Cum am putea să construim o superinteligență artificială care să protejeze valorile umane? Bostrom îl dă exemplu pe Asimov: ”Ilustrarea tradițională este reprezentată de către cele trei legi ale roboticii enunțate, în 1942, de către Isaac Asimov. Ele sunt următoarele: (1) Un robot nu are voie să pricinuiască vreun rău unei ființe umane, sau, prin neintervenție, să permită ca unei ființe omenești să i se facă un rău. (2) Un robot trebuie să se supună ordinelor date de către o ființă umană, atât timp cât ele nu intră în contradicție cu Legea 1. (3) Un robot trebuie să-și protejeze propria existență, atât timp cât acest lucru nu intră în contradicție cu Legea 1 sau Legea 2. [De fapt mai există și legea 0, care a fost adăugată mai târziu: Un robot nu are voie să pricinuiască vreun rău umanității sau să permită prin neintervenție ca umanitatea să fie pusă în pericol.] În mod jenant pentru specia noastră, legile lui Asimov sunt acceptate de mai bine de o jumătate de secol, în ciuda problemelor evidente, dintre care unele au fost explorate chiar în scrierile sale. (Probabil că Asimov și-a formulat legile atât de precis astfel încât să poată eșua în moduri interesante, oferind scenarii fertile pentru povestirile sale.)” De fapt, spune Bostrom, limbajul uman este extrem de imprecis. Ce înseamnă ”a nu pricinui vreun rău unei ființe umane”? Sintagma este teribil de vagă și implică foarte mult din subiectivismul uman. O superinteligență artificială globală poate evolua cu ușurință către acțiuni care ar avea consecințe dramatice pentru noi. Vă recomand cu căldură să căutați cartea lui Bostrom și să o citiți. Veți găsi acolo, foarte bine argumentate, mai multe scenarii catastrofale.

Încheiere

Orice nouă tehnologie, care împinge către viitor civilizația umană, este, inevitabil, purtătoare de riscuri. Trebuie să le evaluăm încontinuu și să evităm să adoptăm poziția personajelor care se temeau, în povestea lui Creangă, de drobul de sare. Nu e nevoie de spaime, ci de soluții. Iar eu, optimist cum mă știți, sunt convins că le vom găsi. Lumea de mâine ne bate la ușă și va fi un loc mult mai primitor pentru oameni, decât lumea din zilele noastre.

Cristian Român (n. 1957) este inginer de aeronave și, începând din 1992, jurnalist de știință. Scrie pentru revista Știință și Tehnică și a realizat numeroase emisiuni de popularizare a științei atât pentru televiziune, cât și pentru radio. Este autorul cărții Ultima aventura: Universul. Valoarea textelor sale i-a fost recunoscută prin acordarea, în 2003 și 2006, a Premiului Comisiei Naționale a României pentru UNESCO pentru jurnalismul de știință, secțiunea presă scrisă. De asemenea el a primit Petre Sergescu al Academiei Române pentru cartea ”100 de inovatori români”, al cărei coautor a fost.